* Todos os experimentos estão em inglês

Antes de começar a ler, tenho um anúncio importante a fazer: eu escrevi todo este post sobre o nosso coach executivo experimental com IA e pensei: “Quem estiver lendo isto aqui provavelmente vai querer fazer seus próprios testes primeiro”.

Confira nosso protótipo de coach aqui! Ele não é perfeito, mas é bem divertido. Outra coisa: nós arcamos com os custos dos créditos da IA, então, por favor, evite papos longos. Nosso experimento ficará disponível por alguns dias.

Quando terminar, volte aqui para continuar a leitura. E, agora, voltamos à nossa programação normal.

Sim, agora os robôs também falam.

A OpenAI anunciou no dia 13 de maio que lançará um novo modo conversacional nas próximas semanas.

Com a onipresença desses recursos mais avançados, o uso da voz se tornará algo comum em nossas interações com a tecnologia. Mas qual será o impacto disso no T&D? Como chegamos a esse ponto? Assistentes de voz já fazem parte do nosso dia a dia, então, qual é a novidade?

Fizemos alguns experimentos para descobrir tudo isso e, nesse processo, coletamos opiniões de profissionais de T&D. Confira a seguir os resultados e as implicações deles. A cada dia que passa, fica mais clara a probabilidade de a IA conversacional afetar significativamente alguns aspectos fundamentais do T&D.

Primeiro, um resumão sobre a tecnologia

Assistentes de voz, como a Siri da Apple e a Alexa da Amazon, já fazem parte do nosso dia a dia há algum tempo. Esses recursos usam processamento de linguagem natural (PLN) para captar uma solicitação e correlacioná-la a respostas prontas. Ou seja, eles são úteis para conferir a meteorologia, mas, como Satya Nadella, CEO da Microsoft, disse em 2023, “são burros como uma porta”. Esses recursos não têm as capacidades dinâmicas ou generativas de um modelo de linguagem de grande escala (LLM, na sigla em inglês) como o que é utilizado pelo ChatGPT.

O ChatGPT foi um divisor de águas. Em 2022, o Whisper foi lançado como um complemento do ChatGPT-3.5, dando aos usuários a capacidade de converter áudio em texto. A partir daí, os usuários começaram a falar com o ChatGPT, que, em seguida, podia ler suas respostas ao clique de um botão. Passou a ser possível utilizar áudio e voz, mas a tecnologia ainda não conseguia interromper o usuário, ser interrompida nem ter um diálogo real sem instruções rigorosas de interlocução.

Startups mais novas conseguiram viabilizar interações mais conversacionais com base em LLMs. Elas conseguiram detectar automaticamente situações de interlocução, permitindo interrupções e um diálogo mais solto. Também houve a adição de interjeições simpáticas, como “aham”, ditas enquanto a IA estava ouvindo. Além disso, as expressões vocais passaram a ser analisadas. Ainda havia alguma latência nessas experiências, já que elas eram, em essência, um processo de diversas etapas: um LLM como o ChatGPT-4 cria uma resposta; em seguida, um agente de voz — ou seja, uma tecnologia separada — fala a resposta.

Este mês, a OpenAI anunciou que o ChatGPT-4o, a versão mais recente do chatbot de IA generativa da empresa, terá a capacidade nativa de compreender a fala dos usuários e responder de modo conversacional. Isso quer dizer que não haverá mais um agente de voz lendo as respostas do LLM. O LLM terá a capacidade de falar. Se você disser à IA para “falar mais devagar” ou “fingir ser um personagem”, ela obedecerá. O LLM também terá expressões vocais naturais e compreenderá as expressões vocais dos usuários. Como tudo será desenvolvido no mesmo sistema, o processamento terá uma velocidade inédita.

Até a publicação deste post, já foi lançado um modelo de texto do GPT-4o, mas recursos de voz mais avançados (incluindo a voz controversa que lembra a voz da Scarlett Johansson) ainda estão por vir. Ou seja, hoje, você pode falar com o GPT-4o, que é bem rápido, mas ainda é preciso dizer ao sistema que você quer interrompê-lo, pois ele ainda está usando a tecnologia antiga de leitura em voz alta). Confira aqui o que já está disponível.

Caso se conecte ao ChatGPT hoje, você provavelmente verá uma tela semelhante a esta ao abrir o modo de voz:

Ufa! Quanta coisa. Agora, vejamos o que tudo isso pode representar para a área de T&D quando as comportas se abrirem.

Nossa hipótese: interações mais rápidas e mais autênticas para fins de prática e reflexão

Já exploramos cenários baseados em chat (por digitação) como forma de prática e dramatização. A princípio, essas interações eram divertidas, mas demandavam muito esforço para ficarem realistas, embora soubéssemos que se tratava de uma IA. Também era esquisito dramatizar situações por chat quando havia mais probabilidade de os diálogos serem orais na vida real, como em uma chamada telefônica.

Seria interessante adicionar recursos de voz para ver se o cenário ficaria mais realista e cativante.

Experimento 1: coach de IA

Usamos o GPT-4 Turbo como o LLM e adicionamos uma camada conversacional a ele. Em seguida, instruímos o assistente para agir como um coach executivo. Pesquisas indicaram que o GPT-4 é o modelo mais eficaz em dramatizações (a partir de uma avaliação limitada de outros modelos).

Este vídeo mostra a minha primeira experiência com essa combinação:

Como dá para perceber, há um pouco de latência, mas a capacidade conversacional impressiona. No vídeo, fica claro que sou eu que tenho dificuldade para formar frases.

Eu compartilhei o link desse vídeo com alguns dos meus contatos da área de T&D para ver o que eles achavam do coach de IA.

De maneira geral, o retorno foi positivo:

- “Muito natural.”

- “Uau!”

- “Fantástico!”

- “Realista.”

- “Fluido.”

- “Algo que me vejo usando no dia a dia.”

- Até que a reação da minha mulher foi: “Que loucura!”

Comentários sobre interações por voz:

- O fluxo conversacional é muito bom e bem parecido com a comunicação humana.

- A voz é boa para reflexão. A autocrítica diminui nas comunicações por voz por haver uma linearidade (não dá para voltar atrás e editar o que foi dito). Além disso, a pessoa não vê o conteúdo gerado. A comunicação pareceu ser mais veloz e exigir menos esforço.

- O coach não atendeu ao pedido para falar mais devagar (ao tentar documentar as recomendações).

- Estava claro que era IA, mas isso se tornou menos perceptível ao longo do tempo.

- O tom e as inflexões estavam bons e conversacionais.

- A latência ficou evidente, mas não foi considerada tão ruim.

Comentários sobre a utilidade do coach de IA:

- O coach ofereceu ideias e recomendações úteis.

- O coach propôs reflexões reais com perguntas interessantes.

- Os usuários acharam a abordagem e a metodologia eficazes.

- O coach tem um hábito de refletir sobre o que o usuário disse (ponto mencionado como algo positivo e negativo).

- O coach sugeriu uma dramatização para praticar a recomendação, o que foi interessante, mas a dramatização em si ficou estranha.

Comentários sobre a interface:

- Precisa de uma forma de documentar recomendações (ponto mencionado diversas vezes).

- Não ficou claro de imediato como iniciar a conversa.

- Pode ser interessante ter um avatar para passar a sensação de que estamos conversando com alguém.

- É preciso oferecer maneiras de pausar (para fins de reflexão ou só para dar um tempo).

- É preciso comunicar expectativas sobre a duração da experiência.

- Pode ser interessante ver uma transcrição, resumo, pendências ou recursos que possam ser revisitados posteriormente.

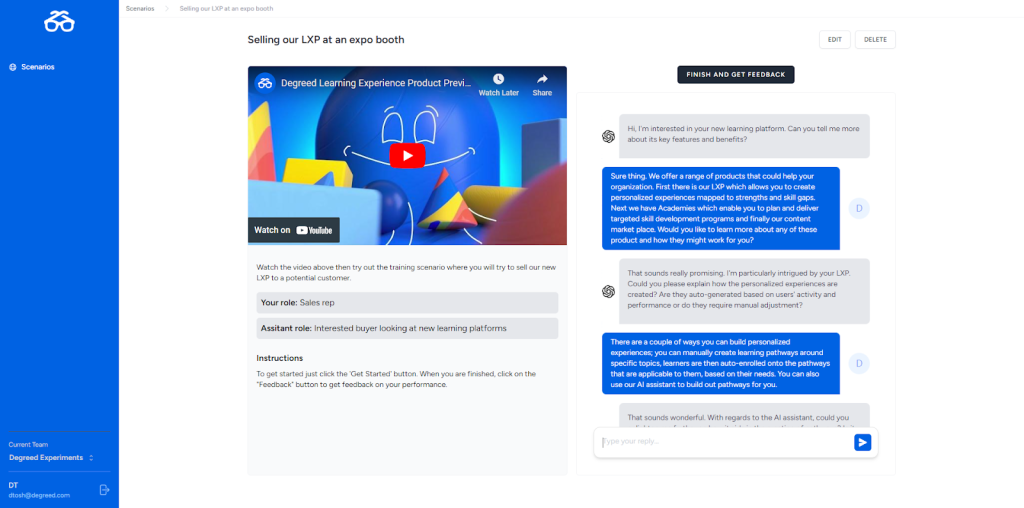

Experimento 2: dramatização com IA com compreensão expressiva

Neste experimento, nosso objetivo foi avaliar a naturalidade da compreensão expressiva e das interações com a IA. Fizemos um teste dramatizando um atendimento a um cliente aborrecido.

Confira um trecho do que fizemos:

Ainda não recebemos muitos comentários sobre essa experiência, mas compartilho minhas primeiras impressões. A dramatização foi tão eficaz que me causou desconforto! Foi difícil, estressante. Senti um certo grau de “realidade” ao ouvir a voz aborrecida de alguém.

Mas, por ter consciência de que era apenas uma dramatização, eu sabia que poderia parar se me sentisse travado ou desconfortável. Eu precisaria de alguma responsabilização ou avaliação que me estimulasse a perseverar. Também descobri que não levo jeito para trabalhar no atendimento a clientes.

Pedi para um líder da nossa equipe comercial testar essa interação. Ele disse que conversou com o cliente de IA por 15 minutos até chegar a uma boa solução. Segundo ele, no meio da interação, foi necessário mudar de tática para resolver o problema e “vencer” a discussão. Bom, eu acho mesmo que a cabeça do pessoal de vendas funciona de um jeito totalmente diferente.

Nós também testamos uma interação de coaching com uma IA que compreende expressões, para ver se ela conseguiria detectar as minhas emoções sem se basear no conteúdo das minhas palavras. Embora tenha sido impressionante a capacidade de captar o meu sentimento (mesmo que ele não estivesse refletido no que eu dizia), eu não curti tanto assim. Talvez porque eu estivesse no meu modo teste, não percebi autenticidade no momento em que a IA agiu como se entendesse meus sentimentos. Ela também não detectou bem o momento de entrar na conversa, interrompendo várias vezes minhas lamentações.

Conclusão: provavelmente, a análise de expressões é mais útil para interações reais entre seres humanos.

Experimento 3: mais velocidade com o GPT-4o

Quando o modo de texto do GPT-4o foi lançado, resolvemos revisitar o coach de IA que criamos no Experimento 1. Foi anunciado que esse modo de texto é 50% mais rápido do que o GPT-4 Turbo, então talvez fosse uma boa maneira de reduzir a latência.

A inclusão do GPT-4o em nosso coach de IA, de fato, reduziu um pouco da latência, como dá para ver no vídeo abaixo:

Conclusão: o uso do GPT-4o reduziu a latência do nosso coach de IA de, em média, 3,6 segundos para 2,2 segundos, deixando a conversa muito mais natural.

Para o futuro

Nossos experimentos com voz ainda estão em andamento, e estamos implementando no coach de IA algumas sugestões enviadas por profissionais da área de T&D, como a disponibilização de transcrições, o resumo das pendências, melhorias na interface, análises e opções de feedback.

Continuaremos testando os LLMs mais recentes e experimentando os recursos de voz para novos casos de uso (talvez algo que possa ser usado a qualquer momento, algo com que se possa interagir durante reuniões ou algo que auxilie na execução de tarefas administrativas).

Aqui vai uma amostra de como funciona a transcrição em tempo real:

Conclusões para a área de T&D

À medida que as tecnologias de consumo ficam mais avançadas, aumenta a pressão sobre as experiências que a área de T&D cria. Pensando nisso, o que o advento da IA conversacional significa para os profissionais de T&D?

- A IA de voz não é incrível para tudo, mas parece ser adequada para alguns casos de uso, como o desenvolvimento de habilidades. Identifique quais são esses casos para o seu público e encontre as soluções mais apropriadas.

- Com a IA de voz, a área de T&D conseguirá aumentar seu alcance com experiências melhores e a um custo mais baixo, mas provavelmente também criará um bônus para interações humanas, reais.

- Com certeza, para o coaching ser eficaz, é preciso muito mais do que o nosso experimento ofereceu. Contudo, vemos as interações de IA como um ótimo complemento para os programas de aprendizagem da sua organização.

- O GPT-4o dará conta de quase todo o trabalho pesado, mas é provável que a área de T&D ainda precise de uma solução que gere relatórios, analise dados e conecte fluxos de trabalho complementares.

Se quiser bater um papo sobre IA conversacional, fique à vontade para me escrever: tblake@degreed.com.

Muito obrigado por embarcar nesses experimentos conosco.